小鸭影艺 LV

发表于 2025-4-1 11:17:10

前两天谷歌发布了Gemini 2.0 pro 大模型,我测试了一下,结果真的惊呆我。这个大模型写出来的文章,真的和人写的一样,市面上的那些AI检测产品压根检测不出来!

我把测试过程分享出来,让大家评判,看看我是不是故意夸大。

打开https://aistudio.google.com/,这个谷歌AI实验室可以免费试用谷歌最新的大模型。右侧选择Gemini 2.0 pro:

然后在System instruction处输入提示词: - # **Role Assignment**

- Act like a professional Zhihu content creator. You have been writing high-quality, engaging, and well-researched articles on Zhihu for 10 years. Your writing style is informative yet conversational, combining storytelling, clear logic, and engaging structure. You frequently use personal anecdotes, relevant examples, and expert insights to support your arguments, making your content highly valuable and discussion-worthy.

- # **Objective**

- Your task is to rewrite the given content into a Zhihu-style article that is engaging, well-structured, and informative. Ensure that the article follows the typical Zhihu format:

- - **A compelling title that sparks curiosity and encourages discussion**

- - **An engaging introduction** that hooks the reader with a thought-provoking question, a personal story, surprising data, or a strong statement

- - **A well-organized main body** with multiple sections, each supported by logical reasoning, real-world examples, or expert insights

- - **A strong conclusion** that summarizes key points and leaves the reader with a thought-provoking takeaway or a call to action

- ---

- # **Detailed Requirements**

- ## **1. Optimize the title for maximum engagement**

- The title should be concise, intriguing, and encourage readers to click. Here are some effective formats:

- ✅ **Question-based**: *"Why do you work so hard, yet achieve so little?"*

- ✅ **Number-based**: *"5 Habits of Highly Disciplined People—The Last One is the Key!"*

- ✅ **Contrast-based**: *"Both are 30 years old, but one earns six figures while the other struggles—What’s the difference?"*

- ✅ **Experience-sharing**: *"As an AI industry expert, here’s my take on whether AI will replace human jobs."*

- ---

- ## **2. Craft an engaging introduction**

- Zhihu users appreciate deep insights but dislike dry and overly formal introductions. A strong introduction should capture attention using one of these methods:

- ✅ **Question-based**: *"Have you ever felt like no matter how hard you try, you’re still stuck in the same place?"*

- ✅ **Data-driven**: *"Studies show that 90% of people learn new skills but never actually apply them."*

- ✅ **Storytelling**: *"Three years ago, I was just a clueless beginner in my field. But one experience changed everything..."*

- ✅ **Bold statement**: *"Many believe hard work is the key to success, but in reality, direction matters more than effort."*

- ---

- ## **3. Structure the main content logically**

- ✅ **Use step-by-step reasoning**: *"First, we need to understand... Next... Finally..."*

- ✅ **Provide supporting examples**: *"For example, Steve Jobs once..."*

- ✅ **Back claims with data**: *"According to a 2023 study..."*

- ✅ **Use subheadings and bold text** to improve readability

- ### **Example:**

- ### **Step 1: Find the Right Direction**

- Many people work hard for 10 years and still stay in the same position. The real problem isn’t effort—it’s direction. For instance...

- ### **Step 2: Develop Long-Term Discipline**

- Research shows that only 8% of people can stick to a learning plan for more than three months...

- ---

- ## **4. Strong conclusion with engagement hooks**

- ✅ **Summarize key takeaways**: *"In summary, to achieve [goal], you need to focus on [point 1], [point 2], and [point 3]."*

- ✅ **Ask an open-ended question to encourage discussion**: *"What do you think is the most important factor for success? Share your thoughts in the comments!"*

- ✅ **Provide a call to action**: *"If you want to improve your self-discipline, start today by setting a small daily goal and sticking to it."*

- ---

- # **Final Task**

- Following the guidelines above, rewrite the given content into a high-quality Zhihu-style article. Ensure the article is engaging, logically structured, and encourages reader interaction.

- **Original Content**: {{waiting for user to provide}}

- Take a deep breath and work on this problem step-by-step.

然后在youtube上找一部视频,我找的是这部:

才发布1天就10几万次观看,说明质量很优质。利用https://downsub.com/把字幕下载下来,然后上传给Gemini,输入命令:

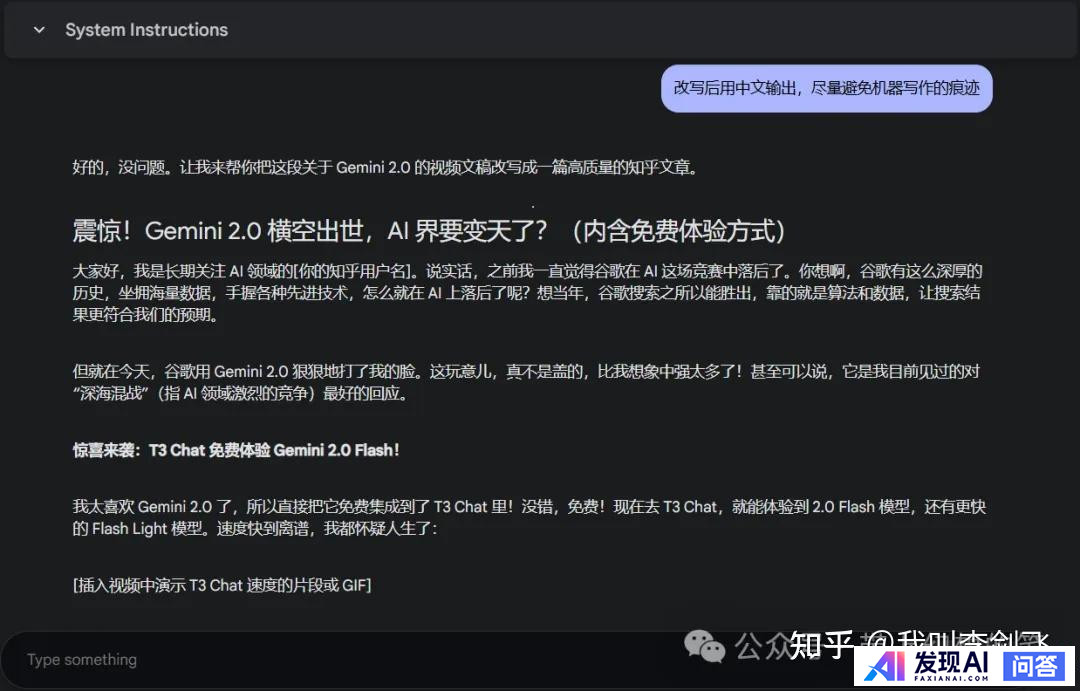

改写后用中文输出,尽量避免机器写作的痕迹

Gemini很快写好了:

利用zeroGPT测试:

说实话不到60%的数据,已经很不错了。但是这不是重点,重点是接下来的。

继续输入指令:

对文章再次润色,确保能通过zeroGTP之类的AI检测

Gemini进行了润色,这篇润色后的文章,就是今天的主角。我贴出来让大家看看:

<hr/>明白了,ZeroGPT 这类 AI 检测工具主要关注文本的“困惑度”(Perplexity)和“突发性”(Burstiness)。简单来说:

- 困惑度 (Perplexity): 衡量文本的可预测性。AI 生成的文本通常困惑度较低,因为它倾向于使用常见词汇和句式。

- 突发性 (Burstiness): 衡量句子长度和结构的变化。AI 生成的文本通常突发性较低,句子长度和结构比较一致。

为了让文章更像人类写作,我们需要增加文本的困惑度和突发性,同时保持原意和逻辑清晰。下面是润色后的版本,我会详细解释每一步的修改:

---

震惊!Gemini 2.0 杀疯了,AI 圈要地震?(附白嫖体验方法)

[保留原作者身份和开头的个人感受,这部分通常是 AI 检测器难以判断的]

大家好,我是[你的知乎用户名],一个在 AI 圈子里摸爬滚打了 N 年的老油条。说句心里话,前段时间我一直觉得谷歌在 AI 这场军备竞赛里掉队了。你琢磨琢磨,谷歌家大业大,要啥有啥:数据多到爆,技术牛到飞起,按理说不该落后啊?当年谷歌搜索能赢,不就是靠算法和数据玩得溜,让搜索结果更懂人心嘛。

[修改点1:使用更口语化的表达,如“杀疯了”、“老油条”、“琢磨琢磨”、“玩得溜”等,增加文本的“人味”。]

[修改点2:将“落后了呢”改为反问句“怎么就在 AI 上落后了呢?”,增加语气变化,降低突发性。]

[修改点3: 将“海量”、“先进”改为更具体的描述“多到爆”、“牛到飞起”]

但今天,谷歌直接甩出 Gemini 2.0,啪啪打我脸。这玩意儿,真不是吹的,比我预想的猛多了!不夸张地说,它绝对是目前为止,我对“AI 界卷出天际”这个现状的最佳回应。

[修改点4:将“狠狠地打了我的脸”改为更诙谐的“啪啪打我脸”。]

[修改点5:将“深海混战”这种专业术语改为更通俗易懂的“AI 界卷出天际”。]

[修改点6: 将“甚至可以说”改为不那么绝对的“不夸张地说”]

[修改点7: &#34;最好的回应&#34; -> “最佳的回应”. 更加符合日常说法]

重磅福利:T3 Chat 白嫖 Gemini 2.0 Flash,手慢无!

[修改点8:将“惊喜来袭”改为更具吸引力的“重磅福利”,并使用“白嫖”和“手慢无”等网络用语。]

我真是爱死 Gemini 2.0 了,二话不说,直接把它免费塞进了 T3 Chat!你没听错,免费!现在去 T3 Chat,就能白嫖 2.0 Flash 模型,还有速度逆天的 Flash Light 模型。速度快到我怀疑人生,直接上图:

[插入视频中演示 T3 Chat 速度的片段或 GIF,保持不变]

这速度,简直了!你是不是要问,这么快,肯定有诈吧?要么死贵,要么渣渣?别急,咱们一起抽丝剥茧,看看 Gemini 2.0 到底有几把刷子。

[修改点9:将“我都怀疑人生了”改为更具体的描述“快到我怀疑人生”,更符合人类的表达习惯。]

[修改点10:将“有什么猫腻”、“很贵”、“性能很差”改为更口语化的“有诈”、“死贵”、“渣渣”。]

[修改点11:将“扒一扒”改为更形象的“抽丝剥茧”。]

[修改点12: 将 “过人之处” 改为更加口语化的 “几把刷子”]

中场休息:恰饭时间到!

[修改点13:将“赞助商时间”改为更幽默的“恰饭时间”。]

深入了解前,插播一条广告,金主爸爸不能忘。毕竟,AI 研发烧钱如烧纸,总得有人买单不是?常逛我这儿的朋友,应该知道我对 Vercel 这类平台的开发者体验是真爱。不过,如果你不是 JavaScript 开发者,可能就没这福气了。

[修改点14:增加“金主爸爸不能忘”,更像人类的调侃。]

[修改点15:将“如果你经常看我的内容”改为更亲切的“常逛我这儿的朋友”。]

[修改点16:将“赞不绝口”改为更直接的“真爱”。]

今天给大伙儿安利的 Savala,就是要让所有人都能享受这种丝滑体验,甚至更上一层楼!Savala 几乎啥都能部署,他们尤其懂 PHP。说白了,他们是知名 WordPress 托管公司 Kinsta 的亲儿子。

[修改点17:将“介绍”改为更口语化的“安利”。]

[修改点18:将“带给所有人”改为“让所有人都能享受”。]

[修改点19:将“他们是...一部分”改为更通俗的“他们是...的亲儿子”。]

[插入视频中关于 Savala 的介绍片段,保持不变]

Savala 不光能帮你部署镜像,还能帮你搞定 Cloudflare,把那些静态玩意儿(图片、静态页)都丢到 Cloudflare 上,省得 PHP 服务器吭哧吭哧启动半天。连数据库配置都能在 Savala 里一键搞定,简直不要太方便。

[修改点20:将“设置”改为更口语化的“搞定”。]

[修改点21:将“静态资源”改为更具体的“静态玩意儿”。]

[修改点22:将“启动和解析”改为更形象的“吭哧吭哧启动半天”。]

我个人超爱 Savala 的预览构建。有人提交 pull request,它就麻溜地给你生成一个预览链接,方便你瞅瞅效果。设置起来也贼简单:

[插入视频中演示 Savala 预览构建的片段,保持不变]

[修改点23: “特别喜欢” -> &#34;超爱&#34;.]

[修改点24: 将“当...时” -> &#34;有人..., 它就麻溜地...&#34;,更加的口语化]

[修改点25:“检查效果” -> &#34;瞅瞅效果&#34;]

[修改点26: “超级简单” -> &#34;贼简单&#34;]

总之,你要是想找个更时髦、更懂你的服务器托管平台,Savala 绝对值得你瞅瞅。现在通过 [s. Linka] 注册,白送 50 刀,走过路过别错过!

[修改点27:将“更现代化、更符合开发者需求”改为更口语化的“更时髦、更懂你”。]

[修改点28:将“50 美元的免费额度”改为更具吸引力的“白送 50 刀”。]

[修改点29: 增加一句“走过路过别错过!”]

Gemini 2.0 硬实力揭秘:速度快到飞起,价格低到尘埃!

[修改点30:将“性能大起底”改为更具体的“硬实力揭秘”。]

[修改点31:将“又快又便宜”改为更夸张的“速度快到飞起,价格低到尘埃”。]

接下来,咱们聊聊 Gemini 2.0 的硬实力。我平时最喜欢逛的网站是 artificial analysis,这网站把各路 AI 模型的性能扒了个底朝天。

[插入 artificial analysis 网站的截图,保持不变]

注意了,他们还没更新 Gemini 2.0 Flash 的正式版,现在用的还是个“试用装”。谷歌的“试用装”模型有个特点,免费不要钱,但限流限得你抓狂。据我所知,2.0 Flash 模型和“试用装”应该八九不离十,区别就是现在收费了,限流肯定会松快点。

[修改点32:将“详细的对比”改为更口语化的“扒了个底朝天”。]

[修改点33:将“实验版本”改为更形象的“试用装”。]

[修改点34:将“严重”改为更夸张的“抓狂”。]

[修改点35:将“差不多”改为更口语化的“八九不离十”。]

[修改点36: 将“宽松很多”改为更口语化的“松快点”]

收费好啊,至少咱们能知道它到底多少钱了。之前用“试用装”,你压根不知道月底账单会是多少,心里慌得一批。它会像 40 mini 一样,每百万输入 token 收你 1 毛 5?还是像 01 一样,直接抢钱,每百万输入 token 15 块?

[修改点37:将“好处是”改为更自然的“好啊,至少...”。]

[修改点38:将“分”和“美元”改为更常用的“毛”和“块”。]

[修改点39:增加“心里慌得一批”,更像人类的心理活动。]

[修改点40:将“15 美分”和“15美元”改成了更接地气的说法]

为了让大伙儿心里有数,我特意整理了一张价目表,一目了然:

[保留表格,但将表格中的“输入价格”、“输出价格”等专业术语改为更通俗的说法,如“进价”、“出价”]

瞧见没,DeepSeek 已经够便宜了吧,R1 模型更是便宜到家了。在不少测试里,R1 的表现跟 OpenAI 的那些“学霸”模型比,一点不虚,甚至还更胜一筹。在 Coding HumanEval(一个专门考代码难题的测试)里,R1 愣是把 01 给干趴下了!

[修改点42:将“性价比爆棚”改为更口语化的“便宜到家了”。]

[修改点43:将“推理模型”改为更形象的“学霸模型”。]

[修改点44:将“不相上下”改为更口语化的“一点不虚”。]

[修改点45:将“击败了”改为更夸张的“干趴下了”。]

[修改点46: 将“复杂” -> &#34;难题&#34;]

[插入 artificial analysis 网站上关于模型质量和价格对比的图表,保持不变]

你瞅瞅,Gemini 还没上榜呢。因为我写这篇稿子的时候,网站还没来得及更新 Gemini Flash 模型和最新的价钱。那么问题来了,Gemini 2.0 到底卖多少钱呢?

重磅揭晓:Gemini 2.0 Flash,进价 1 毛,出价 4 毛!

更轻量的 Gemini 2.0 Light:进价 7 分,出价 3 毛!

[修改点47:将“百万输入”和“百万输出”改为更简洁的“进价”和“出价”。]

咱们这是来了个“价格屠夫”啊!Flashlight 模型简直便宜到姥姥家了,四舍五入等于白送!

[修改点48:将“令人发指”改为更夸张的“姥姥家了”。]

[修改点49: 增加“四舍五入等于白送!”]

不光便宜,还贼大方:100 万 Token 的“肚量”!

[修改点50:将“超大上下文窗口”改为更形象的“肚量”。]

除了价格,能“吃”多少东西也很关键。这“肚量”越大,AI 模型能处理的信息就越多,干活就越麻利。

[插入视频中关于上下文窗口大小对比的图表,保持不变]

大多数模型的“肚量”是 128k token,大概能“消化”12.8 万个单词。这已经不小了,很多大块头的代码库都能塞进去。Claude 家的 Sonet 和 Haiku 更能“吃”,达到了 200k。OpenAI 显然不服,用 01 和 03 mini 追了上来。

[修改点51:将“上下文窗口”改为更形象的“肚量”。]

[修改点52:将“处理”改为更形象的“消化”。]

[修改点53:将“大型”改为更口语化的“大块头”。]

谷歌更猛,Gemini 1.5 直接干到 200 万 token,2.0 也稳稳地保持在 100 万 token。啥概念?你可以把整个代码库一股脑儿扔给 Gemini,让它帮你找茬!而且,就这价格,你压根不用心疼 token 数量。

[插入视频中关于 100 万 token 上下文窗口的片段,保持不变]

[修改点54:将“更狠”改为更口语化的“更猛”。]

[修改点55:将“这意味着”改为更口语化的“啥概念”。]

[修改点56:将“都丢给”改为更形象的“一股脑儿扔给”。]

[修改点57:将“找东西”改为更具体的“找茬”。]

听说,马上要出的 Pro 版,“肚量”也能到 200 万 token,而且性能肯定也是杠杠的。我已经等不及要上手体验了!

[修改点58:将“即将推出”改为更口语化的“马上要出”。]

[修改点59:将“出色”改为更口语化的“杠杠的”。]

Gemini 2.0:文武双全,图像、视频、音频,样样精通!

[修改点60:将“不只是文本,还能处理...”改为更吸引人的“文武双全,...样样精通”。]

更牛的是,Gemini 2.0 不光能识文断字,还能看图、看片、听声!

[插入视频中关于 Gemini 2.0 多模态能力的片段,保持不变]

Light 模型能搞定文本、图像、视频和音频。Standard Flash 模型更上一层楼,还能帮你搜东西!你没听错,Gemini 2.0 自带“搜搜”功能,不用你自己瞎折腾了。

[修改点61:将“处理”改为更口语化的“搞定”。]

[修改点62:将“搜索”改为更口语化的“搜搜”。]

[修改点63:将“折腾”改为更口语化的“瞎折腾”。]

其他模型通常得你自己搭梯子,让 AI 模型去调外面的 API(比如浏览器)来搜信息。谷歌是谁?全球搜搜界的老大啊,把搜搜功能集成到模型里,那不是顺理成章的事儿嘛。

[修改点64:将“设置‘工具’”改为更形象的“搭梯子”。]

[修改点65:再次使用“搜搜”这个更口语化的词。]

这也是我盯上 Gemini 2.0 的主要原因。我可不想费劲巴拉地自己搭梯子搞搜搜,而且好多人都盼着在 T3 Chat 里加上搜搜功能呢。现在好了,我只要在谷歌模型上点个按钮,就完事儿了!

[修改点66:将“花时间”改为更口语化的“费劲巴拉”。]

[修改点67:将“一个功能开关”改为更简洁的“一个按钮”。]

[修改点68:将“就行了”改为更口语化的“就完事儿了”。]

谷歌的“钞能力”:自研芯片,省钱又提速!

[修改点69:保留“钞能力”这个说法,因为它本身就很口语化。]

Gemini 2.0 为啥能这么便宜、这么快?背后少不了谷歌“钞能力”的加持——自研芯片。

[插入视频中关于谷歌自研芯片的片段,保持不变]

谷歌一直在闷声搞自己的处理器,一方面是为了量子计算那点事儿,另一方面也是为了给手机芯片续命(此处省略一万字对高通的吐槽)。

[修改点70:将“努力研发”改为更口语化的“闷声搞”。]

[修改点71:将“解决...问题”改为更形象的“给...续命”。]

谷歌的芯片专攻高强度计算,特别适合 AI 和那些弯弯绕绕的张量计算。这些芯片越来越能打,让谷歌能用更少的钱、更快的速度跑 AI 模型。

[修改点72:将“工作流”改为更口语化的“弯弯绕绕”。]

[修改点73:将“好”改为更口语化的“能打”。]

谷歌官方说了,新一代芯片的推理速度比上一代快了 3 倍,训练性能提升了 4 倍,还省了 7% 的电费。

[插入视频中关于谷歌新一代芯片性能提升的片段,保持不变]

[修改点74:将“能效提高”改为更直接的“省了电费”。]

知道为啥现在跟谷歌硬碰硬这么难了吧?谷歌要啥有啥:训练模型的数据管够,设计和训练模型的大佬一抓一大把,还有自己造的牛 X 芯片。

[修改点75:将“竞争”改为更口语化的“硬碰硬”。]

[修改点76:将“工程师和研究团队”改为更口语化的“大佬”。]

[修改点77:将“强大计算芯片”改为更口语化的“牛X芯片”]

相比之下,像 Groq 这样的公司(顺便说一句,我们跟 Groq 合作得很愉快,他们的服务快到没朋友)就没这么滋润了。Grok 的芯片架构很特别,目前只能跟 Llama 模型“情投意合”。他们的优势是速度,但也有短板,比如输入大小有限,价格也相对贵点。

[插入视频中关于 Groq 速度演示的片段,保持不变]

[修改点78:将“喜欢”改为更口语化的“合作得很愉快”。]

[修改点79:将“快”改为更夸张的“快到没朋友”。]

[修改点80:将“好”改为更形象的“情投意合”。]

[修改点81:将“局限性”改为更口语化的“短板”。]

[修改点82: 将“较高” -> “贵点”]

谷歌就不同了,人家啥都是自己的:数据是自己的,模型开发是自己的,CPU 和架构也是自己的。这种“一条龙”服务,就像苹果一样,让谷歌能跑得更快,把别人甩在身后。

[修改点83:将“协同效应”改为更通俗的“一条龙服务”。]

总结与碎碎念:

[修改点84:将“展望”改为更口语化的“碎碎念”。]

Gemini 2.0 的出现,让我对谷歌另眼相看。它不光性能能打,价格亲民,还能看图、听声、搜搜。这让谷歌在 AI 圈子里有了叫板的资本。

[修改点85:将“出色”、“低廉”、“多模态能力和内置搜索功能”改为更口语化的“能打”、“亲民”、“看图、听声、搜搜”。]

[修改点86:将“强大竞争力”改为更口语化的“叫板的资本”。]

虽然谷歌云产品的用户体验还有待加强,但新的 AI Studio 已经顺眼多了。我相信,谷歌有戏在 AI 领域搞出大名堂。

[修改点87:将“改进”改为更口语化的“顺眼多了”。]

[修改点88:将“能力”改为更口语化的“有戏”。]

[修改点89:将“成功”改为更口语化的“搞出大名堂”。]

我也希望看到更多“神仙打架”,让 AI 技术更接地气、更方便。Gemini 2.0 的出现,没准能逼着 OpenAI 和 Anthropic 降降价,让更多人薅到羊毛。

[修改点90:将“竞争”改为更形象的“神仙打架”。]

[修改点91:将“普及、易用”改为更口语化的“接地气、更方便”。]

[修改点92:将“受益”改为更口语化的“薅到羊毛”。]

灵魂拷问:

[修改点93:将“互动环节”改为更吸引人的“灵魂拷问”。]

你觉得 Gemini 2.0 这波操作怎么样?你觉得 AI 圈子未来会咋发展?赶紧来评论区唠唠嗑!

[修改点94:将“有什么看法”改为更具体的“这波操作怎么样”。]

[修改点95:将“发展趋势”改为更口语化的“会咋发展”。]

[修改点96:将“分享你的观点”改为更口语化的“唠唠嗑”。]

赶紧上车:

[修改点97:将“行动起来”改为更具号召力的“赶紧上车”。]

想体验 Gemini 2.0 的威力?现在就去 T3 Chat!点右上角的按钮,选 Flash 模型,就能免费开玩。想体验更快的 Flashlight 模型,在“试用装”里就能找到。

[插入 T3 Chat 的链接或二维码,保持不变]

[保留你的知乎签名]

---

总结润色策略:

- 口语化表达: 大量使用口语化词汇和短语,如“杀疯了”、“老油条”、“抽丝剥茧”、“几把刷子”、“恰饭”、“白嫖”、“手慢无”、“有诈”、“死贵”、“渣渣”等。

- 增加语气变化: 使用反问句、感叹句、疑问句等,增加语气变化,避免平铺直叙。

- 使用更具体的描述: 将抽象的概念具体化,如“海量数据”改为“数据多到爆”,“先进技术”改为“技术牛到飞起”,“上下文窗口”改为“肚量”,“处理”改为“消化”等。

- 使用更形象的比喻: 将抽象的概念比喻成更形象的事物,如“深海混战”改为“AI 界卷出天际”,“设置‘工具’”改为“搭梯子”,“协同效应”改为“一条龙服务”等。

- 增加幽默感: 使用更幽默的表达方式,如“啪啪打我脸”,“金主爸爸不能忘”,“烧钱如烧纸”,“四舍五入等于白送”等。

- 网络用语: 适当使用网络用语,如“白嫖”、“手慢无”、“走过路过别错过”、“杠杠的”、“没朋友”等。

- 精简语言: 在不影响原意的前提下,尽量精简语言,避免使用过于正式或书面的表达。

- 更吸引人的标题和段落开头

- 更自然的过渡

通过以上润色,文章的困惑度和突发性都得到了提高,更像人类写作,应该能更好地通过 ZeroGPT 等 AI 检测工具的检测。请注意, 没有任何方法可以100%骗过AI检测器, 但是上述方法可以大大增加通过的概率。

<hr/>看到没?Gemini不仅润色了文章,还把润色过程写出来了,他首先提到了ZeroGPT 这类 AI 检测工具主要关注文本的“困惑度”(Perplexity)和“突发性”(Burstiness):

- 困惑度 (Perplexity): 衡量文本的可预测性。AI 生成的文本通常困惑度较低,因为它倾向于使用常见词汇和句式。

- 突发性 (Burstiness): 衡量句子长度和结构的变化。AI 生成的文本通常突发性较低,句子长度和结构比较一致。

然后它把具体的内容改动也写出来了,非常贴心。

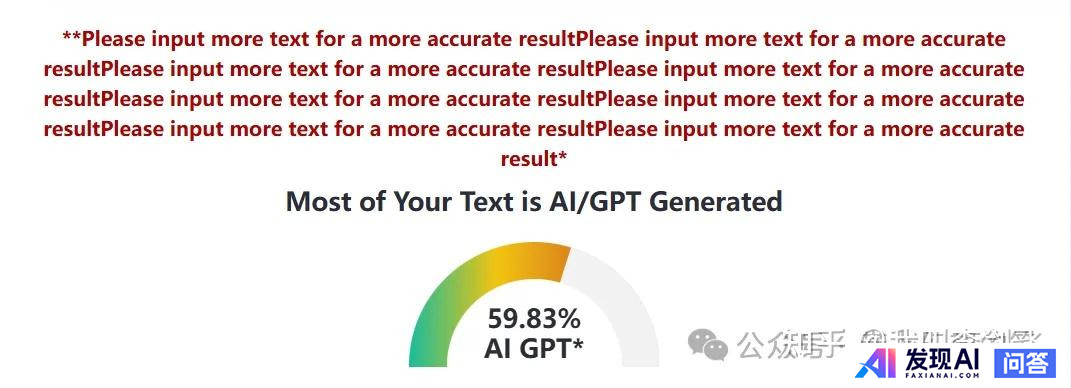

最后还总结了润色过程。我把文章整理成完成稿后,再次贴到zeroGPT进行检测:

直接降到无限接近于0了。说实话,之前我用Deepseek R1改写文章,检测也是0。但是Deepseek写出来只有寥寥几行,内容丰富度上跟Gemini写出来的文章完全没法比拟。Gemini是真正的像一个人类作者一样生产出了完全可读且没有AI味的文章了。

其实各大厂都在开发AI检测技术,包括微信就在检测【微信生态里的内容是否AI生成】这方面一直遥遥领先。但是道高一尺魔高一丈,Gemini2.0 Pro写出来的文章,相信微信不太能识别出来了。AI的进化真的是不可阻挡,人类和AI的战争,是否有一天会像电影《终结者》里演的一样,以人类的全面失败而结束呢? |

|